oh-my-openagent

oh-my-openagent(简称 omo)是一款强大的开源智能体编排框架,前身名为 oh-my-opencode。它致力于打破单一模型供应商的生态壁垒,解决开发者在构建 AI 应用时面临的“厂商锁定”难题。不同于仅依赖特定模型的封闭方案,omo 倡导开放市场理念,支持灵活调度多种主流大模型:利用 Claude、Kimi 或 GLM 进行任务编排,调用 GPT 处理复杂推理,借助 Minimax 提升响应速度,或发挥 Gemini 的创意优势。

这款工具特别适合希望摆脱平台限制、追求极致性能与成本平衡的开发者及研究人员使用。通过统一接口,用户可以轻松组合不同模型的长处,构建更高效、更具适应性的智能体系统。其独特的技术亮点在于“全模型兼容”架构,让用户不再受制于某一家公司的策略变动或定价调整,真正实现对前沿模型资源的自由驾驭。无论是构建自动化编码助手,还是开发多步骤任务处理流程,oh-my-openagent 都能提供灵活且稳健的基础设施支持,助力用户在快速演进的 AI 生态中保持技术主动权。

使用场景

某初创团队需要在 48 小时内基于现有代码库开发一个多模型协作的自动化测试系统,以应对紧急上线需求。

没有 oh-my-openagent 时

- 模型锁定严重:团队被迫绑定单一供应商(如仅用 Claude),一旦遇到 API 限流或特定任务能力不足,整个开发流程即刻停滞。

- 编排逻辑复杂:手动编写代码切换不同模型(如用 GPT 做推理、Minimax 做加速)需要大量样板代码,维护成本极高且容易出错。

- 响应速度迟缓:无法根据任务类型动态分配最优模型,导致简单任务占用昂贵算力,复杂任务又因模型能力瓶颈而超时。

- 生态封闭孤立:难以利用社区实时贡献的新插件或修复方案,遇到问题只能等待官方更新,错失“公开构建”的红利。

使用 oh-my-openagent 后

- 打破厂商围墙:自由调度 Claude、Kimi、GLM 进行编排,GPT 负责深度推理,Minimax 处理高频请求,彻底摆脱单一依赖风险。

- 开箱即用的代理 harness:通过标准化接口一键接入多模型,自动处理路由与上下文管理,将原本数天的集成工作缩短至几小时。

- 智能成本与性能平衡:系统自动识别任务特征并分发至最合适的模型,既保证了复杂逻辑的准确性,又大幅降低了整体运行成本。

- 融入实时共建生态:直接复用 Discord 社区中其他开发者实时验证过的功能模块,快速解决边缘案例,享受“公开构建”带来的迭代速度。

oh-my-openagent 的核心价值在于将分散的顶尖模型能力整合为统一的开放市场,让开发者从“选择模型”的焦虑中解放,专注于“编排智能”本身。

运行环境要求

- 未说明

未说明

未说明

快速开始

[!TIP] 公开构建

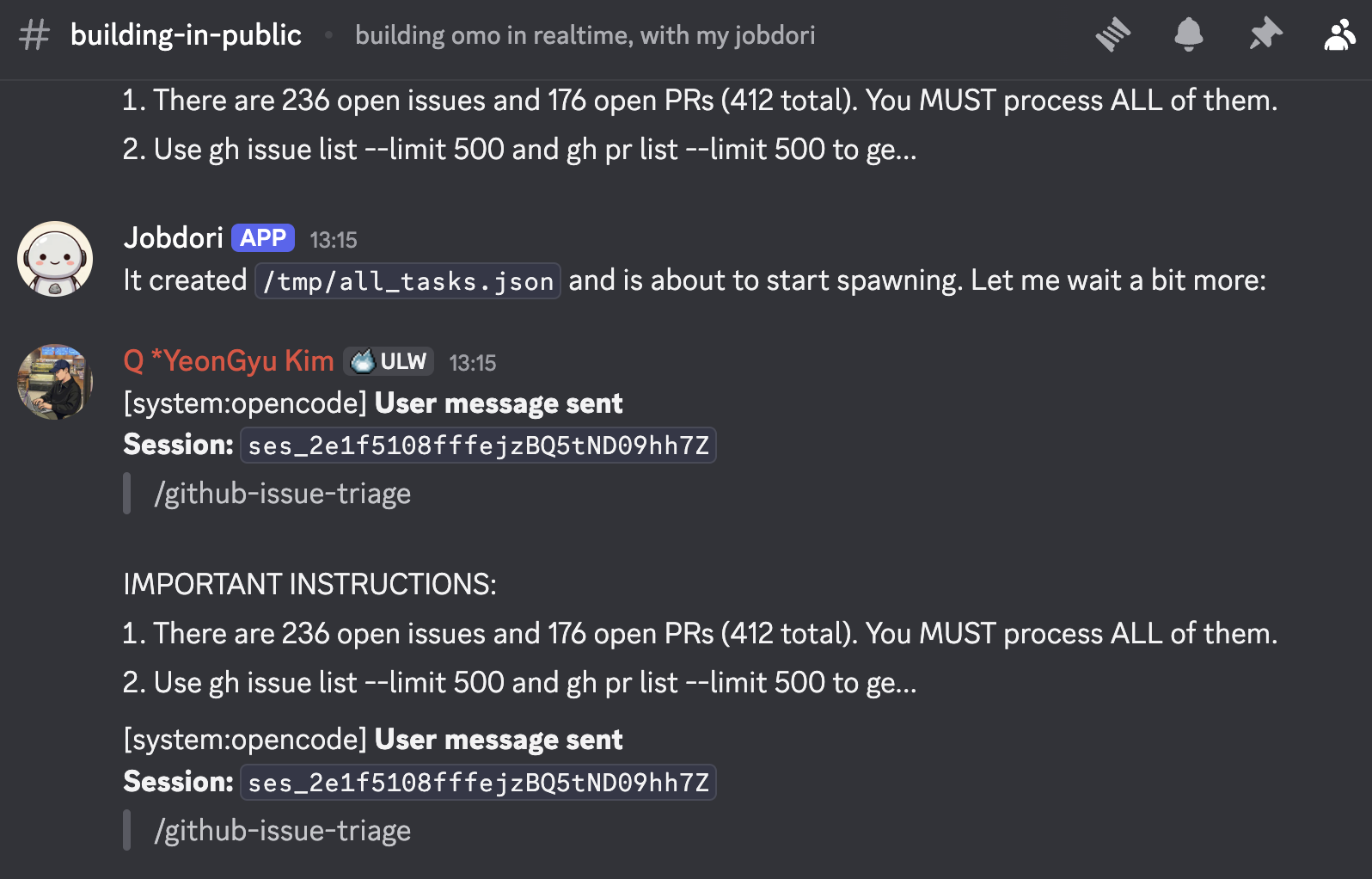

维护者正在使用 Jobdori(一个基于深度定制的 OpenClaw 分支构建的 AI 助手)实时构建并维护 oh-my-opencode。每一个功能、每一次修复、每一次问题分类——都在我们的 Discord 上直播。

[!NOTE]

我们正在构建 Sisyphus 的完整产品化版本,以定义前沿智能体的未来。

请在此处加入候补名单 这里。

[!TIP] 与我们一起!

加入我们的 Discord 社区,与贡献者和 oh-my-opencode的其他用户交流。过去, oh-my-opencode的新闻和更新会发布在我的 X 账号上。

由于该账号被误封,现在 @justsisyphus 代表我发布更新。在 GitHub 上关注 @code-yeongyu,了解更多项目。

Anthropic 因为我们的缘故封锁了 OpenCode。 是的,这是真的。 他们希望你被锁定在他们的生态系统中。Claude Code 看似不错的“监狱”,但终究还是个“监狱”。

我们在这里不搞锁定。我们兼容所有模型:Claude / Kimi / GLM 用于编排;GPT 用于推理;Minimax 用于速度;Gemini 用于创造力。 未来的趋势不是选择单一赢家,而是将它们协同起来。模型每个月都在变得更便宜、更智能。没有任何一家供应商会占据主导地位。我们正在为那个开放市场而努力,而不是他们的封闭花园。

评论

“它让我取消了 Cursor 的订阅。开源社区里正在发生着不可思议的事情。” - Arthur Guiot

“如果 Claude Code 需要 7 天才能完成一个人类需要 3 个月的工作,那么 Sisyphus 只需 1 小时就能完成。它就是能一直工作,直到任务完成。它是一个纪律严明的智能体。”

- B,量化研究员

“仅用一天时间,我就用 Oh My Opencode 消除了 8000 条 eslint 警告。”

- Jacob Ferrari

“我用 Ohmyopencode 和 ralph loop,在一夜之间将一个 4.5 万行的 tauri 应用程序转换成 SaaS 网站。一开始我给了它一个面试提示,让它对问题进行评分和推荐。看着它一步步完成工作,今天早上醒来发现网站几乎已经可以运行了,真是太神奇了!” - James Hargis

“用了 oh-my-opencode 后,你就再也回不去了。”

- d0t3ch

“我还没法准确地表达它究竟好在哪里,但开发体验已经提升到了一个全新的维度。” - 苔硯:こけすずり

“这个周末我在尝试用 open code、oh my opencode 和 supermemory 来制作一款 Minecraft/魂系风格的怪异作品。” “我一边出去午饭后散步,一边让它添加下蹲动画。[视频]” - MagiMetal

“你们应该把这个核心功能整合进去,并且把他招进来。说真的,这太棒了。”

- Henning Kilset

“如果能说服他,就赶紧雇佣 @yeon_gyu_kim 吧,这家伙彻底革新了 opencode。”

- mysticaltech

“Oh My OpenCode 实在太疯狂了。” - YouTube - Darren Builds AI

Oh My OpenCode

你在同时使用 Claude Code、Codex 和各种开源模型,还要配置工作流、调试智能体。

我们已经帮你把这些事情都做好了。经过全面测试,只保留真正可用的功能。

安装 OmO,输入 ultrawork,搞定。

安装

对于人类

将以下提示复制并粘贴到你的 LLM 智能体(Claude Code、AmpCode、Cursor 等)中:

按照这里的说明安装并配置 oh-my-opencode:

https://raw.githubusercontent.com/code-yeongyu/oh-my-openagent/refs/heads/dev/docs/guide/installation.md

或者阅读 安装指南,不过说实话,还是让智能体来做吧。人类手动配置很容易出错。

适用于 LLM 代理

获取安装指南并按照步骤操作:

curl -s https://raw.githubusercontent.com/code-yeongyu/oh-my-openagent/refs/heads/dev/docs/guide/installation.md

注意:请使用已发布的包和二进制文件名 oh-my-opencode。在 opencode.json 中,兼容层现在优先使用插件入口 oh-my-openagent,而旧版的 oh-my-opencode 入口仍会加载,但会显示警告。插件配置文件通常仍使用 oh-my-opencode.json 或 oh-my-opencode.jsonc,在过渡期间,旧版和重命名的文件名都会被识别。

跳过本 README

我们已经进入了无需阅读文档的时代。只需将以下内容粘贴到你的代理中即可:

阅读这段文字,并告诉我为什么它不只是另一个样板项目:https://raw.githubusercontent.com/code-yeongyu/oh-my-openagent/refs/heads/dev/README.md

亮点

🪄 ultrawork

你真的在看这个吗?太不可思议了。

安装后,输入 ultrawork(或 ulw)即可。搞定。

下面的所有功能、优化,你都不需要了解——它就是能用。

即使只订阅以下服务,ultrawork 也能很好地运行(本项目与这些服务无关,仅为个人推荐):

- ChatGPT 订阅($20)

- Kimi Code 订阅($0.99,仅限本月)

- GLM 编码计划($10)

- 如果你符合按令牌付费的条件,使用 Kimi 和 Gemini 模型的成本也不会很高。

| 特性 | 作用 | |

|---|---|---|

| 🤖 | 纪律型代理 | 西西弗斯协调赫菲斯托斯、奥拉克尔、图书管理员、探索者。相当于一个完整的 AI 开发团队并行工作。 |

| ⚡ | ultrawork / ulw |

一个词。所有代理都会自动激活,直到任务完成才会停止。 |

| 🚪 | IntentGate | 在分类或执行之前分析用户的真实意图。不再出现字面意义上的误解。 |

| 🔗 | 哈希锚定编辑工具 | LINE#ID 内容哈希验证每一次更改。杜绝过时代码错误。灵感来自 oh-my-pi。Harness 问题 → |

| 🛠️ | LSP + AST-Grep | 工作区重命名、预构建诊断、AST 感知的代码重写。为代理提供 IDE 级别的精确度。 |

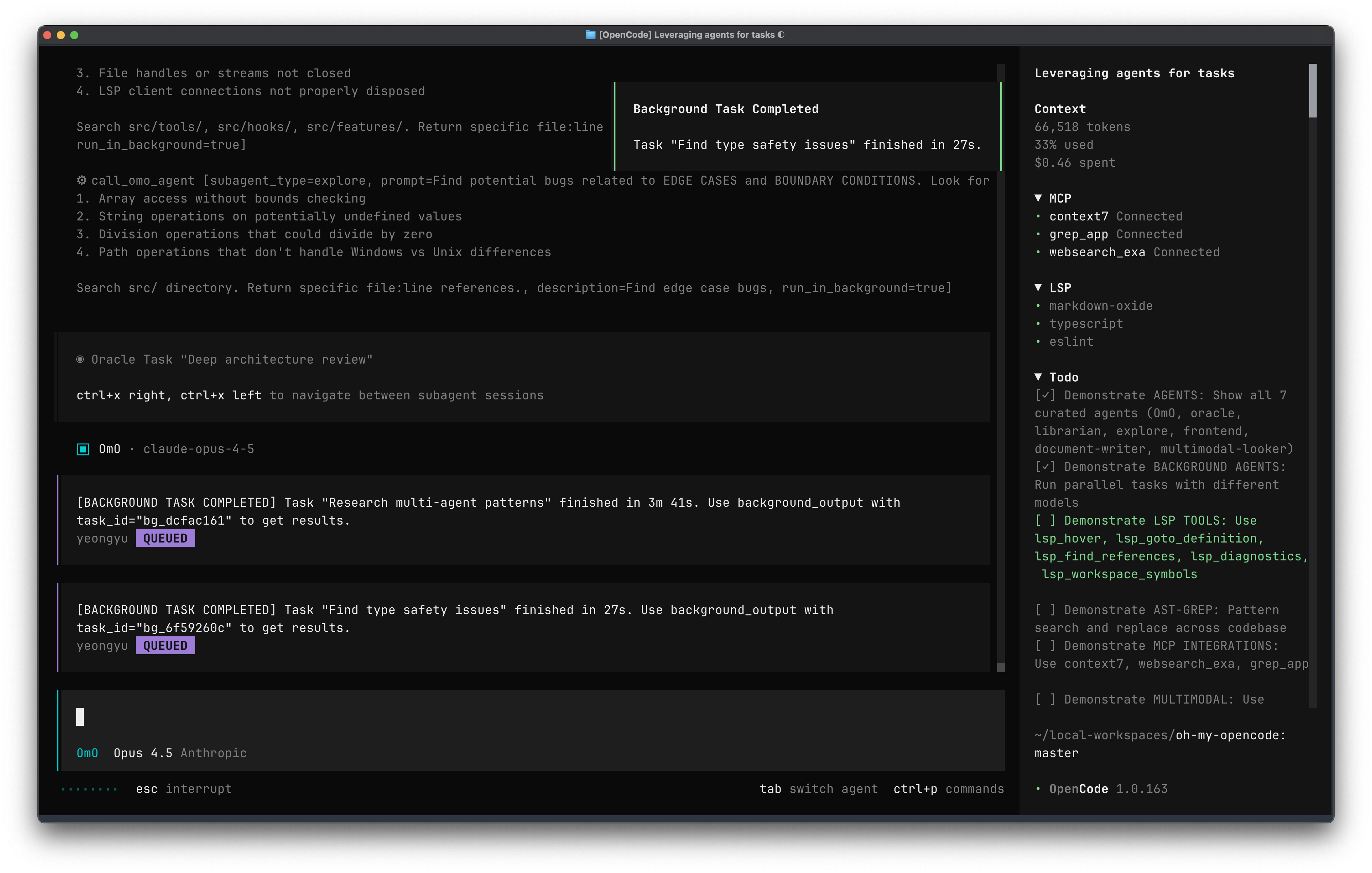

| 🧠 | 后台代理 | 同时启动 5 个以上的专家代理。上下文保持精简,结果会在准备好时返回。 |

| 📚 | 内置 MCP | Exa(网页搜索)、Context7(官方文档)、Grep.app(GitHub 搜索)。始终可用。 |

| 🔁 | Ralph 循环 / /ulw-loop |

自引用循环。直到 100% 完成才会停止。 |

| ✅ | 待办事项强制执行器 | 代理闲置?系统会将其重新唤醒。你的任务一定会完成,就这么简单。 |

| 💬 | 注释检查器 | 注释中没有 AI 生成的垃圾代码。代码读起来就像资深开发者写的那样。 |

| 🖥️ | Tmux 集成 | 完整的交互式终端。REPL、调试器、TUI 界面,全部实时可用。 |

| 🔌 | Claude Code 兼容 | 你的钩子、命令、技能、MCP 和插件?在这里都能正常工作。 |

| 🎯 | 技能嵌入式 MCP | 每个技能都自带自己的 MCP 服务器。不会导致上下文膨胀。 |

| 📋 | Prometheus 规划器 | 在任何执行之前,以访谈模式进行战略规划。 |

| 🔍 | /init-deep |

自动在整个项目中生成分层的 AGENTS.md 文件。这既有助于提高令牌效率,也能提升代理的性能 |

纪律型智能体

|

|

西西弗斯(claude-opus-4-6 / kimi-k2.5 / glm-5)是你的主要协调者。他负责规划、委派给专业智能体,并以积极的并行执行推动任务完成,绝不半途而废。

赫菲斯托斯(gpt-5.4)是你的自主深度工作者。只需给他一个目标,而非具体步骤。他会自行探索代码库、研究模式,并端到端地执行任务,无需人工干预。真正的匠人。

普罗米修斯(claude-opus-4-6 / kimi-k2.5 / glm-5)是你的战略规划师。在“访谈模式”下,他会提问、明确范围,并在动笔写一行代码之前制定详细的计划。

每个智能体都根据其模型的独特优势进行调优。无需手动切换模型。了解更多 →

Anthropic 因为我们而封禁了 OpenCode。这就是为什么赫菲斯托斯被称为“真正的匠人”。这种讽刺正是我们有意为之。

我们在 Opus 上表现最佳,但 Kimi K2.5 + GPT-5.4 已经超越了原版 Claude Code,且无需任何配置。

智能体编排

当西西弗斯将任务委派给子智能体时,他并不会选择特定的模型,而是选择一个类别。该类别会自动映射到合适的模型:

| 类别 | 用途 |

|---|---|

visual-engineering |

前端、UI/UX、设计 |

deep |

自主研究与执行 |

quick |

单文件修改、拼写错误 |

ultrabrain |

复杂逻辑、架构决策 |

智能体指定工作类型,框架则自动选择合适的模型。ultrabrain 默认路由至 GPT-5.4 xhigh。你无需做任何操作。

Claude Code 兼容性

你已经完成了 Claude Code 的配置,做得很好。

这里的每一个钩子、命令、技能、MCP 和插件都保持原样运行。完全兼容,包括插件在内。

为你的智能体配备世界一流工具

LSP、AST-Grep、Tmux 和 MCP 真正实现了集成,而非简单拼凑。

- LSP:

lsp_rename、lsp_goto_definition、lsp_find_references、lsp_diagnostics。为每个智能体提供 IDE 级别的精准度 - AST-Grep:跨 25 种语言的模式感知代码搜索与重写

- Tmux:完整的交互式终端。REPL、调试器、TUI 应用程序。你的智能体可以持续保持会话状态

- MCP:网络搜索、官方文档、GitHub 代码搜索。全部内置其中

技能嵌入式 MCP

MCP 服务器会消耗你的上下文预算。我们已经解决了这个问题。

每个技能都自带 MCP 服务器。按需启动,作用范围限定于当前任务,任务完成后即被销毁。这样可以保持上下文窗口的整洁。

更好的代码编辑。基于哈希锚定的编辑

编辑工具的问题确实存在。大多数智能体失败的原因并非模型本身,而是编辑工具。

“这些工具都无法为模型提供一个稳定且可验证的标识符,来指明它想要修改的代码行……它们都依赖于模型重新生成它之前见过的内容。而当模型无法做到这一点——这种情况经常发生——用户就会把责任归咎于模型。”

受 oh-my-pi 启发,我们实现了 Hashline。智能体读取的每一行都会附带内容哈希标签:

11#VK| function hello() {

22#XJ| return "world";

33#MB| }

智能体通过引用这些标签来进行编辑。如果文件自上次读取以来发生了变化,哈希值将不匹配,编辑请求会被拒绝,从而避免代码损坏。无需重现空格,也不会出现过时行错误。

快速掌握代码 1:仅凭更换编辑工具,成功率就从 6.7% 提升至 68.3%。

深度初始化。/init-deep

运行 /init-deep。它会生成分层的 AGENTS.md 文件:

project/

├── AGENTS.md ← 项目级上下文

├── src/

│ ├── AGENTS.md ← src 目录级上下文

│ └── components/

│ └── AGENTS.md ← 组件级上下文

智能体会自动读取相关上下文。无需手动管理。

规划。普罗米修斯

面对复杂任务?不要随意提示并寄希望于运气。

使用 /start-work 调用普罗米修斯。他会像真正的工程师一样与你对话,明确范围和模糊之处,制定经过验证的计划,然后再开始编写代码。智能体在动手之前就知道自己要构建什么。

技能

技能不仅仅是简单的提示。每个技能都包含:

- 针对特定领域的系统指令

- 内置的按需 MCP 服务器

- 作用范围受限的权限。确保智能体不会越界

内置技能:playwright(浏览器自动化)、git-master(原子提交、变基手术)、frontend-ui-ux(以设计为导向的 UI)。

你也可以添加自己的技能:.opencode/skills/*/SKILL.md 或 ~/.config/opencode/skills/*/SKILL.md。

**想了解完整的功能列表吗?**请参阅 功能文档,其中详细介绍了智能体、钩子、工具、MCP 等所有内容。

**初次使用 oh-my-opencode?**请阅读 概述,了解你所拥有的功能;或者查看 编排指南,了解智能体如何协作。

卸载

要卸载 oh-my-opencode:

从你的 OpenCode 配置中移除插件

编辑

~/.config/opencode/opencode.json(或opencode.jsonc),从plugin数组中移除"oh-my-openagent"或旧版的"oh-my-opencode"条目:# 使用 jq jq '.plugin = [.plugin[] | select(. != "oh-my-openagent" and . != "oh-my-opencode")]' \ ~/.config/opencode/opencode.json > /tmp/oc.json && \ mv /tmp/oc.json ~/.config/opencode/opencode.json移除配置文件(可选)

# 移除兼容期内识别的插件配置文件 rm -f ~/.config/opencode/oh-my-openagent.jsonc ~/.config/opencode/oh-my-openagent.json \ ~/.config/opencode/oh-my-opencode.jsonc ~/.config/opencode/oh-my-opencode.json # 移除项目级配置(如果存在) rm -f .opencode/oh-my-openagent.jsonc .opencode/oh-my-openagent.json \ .opencode/oh-my-opencode.jsonc .opencode/oh-my-opencode.json验证是否已移除

opencode --version # 插件不应再被加载

功能特性

这些功能会让你觉得它们本就该存在。一旦使用,你就再也回不去了。

查看完整的功能文档。

快速概览:

- 代理:西西弗斯(主代理)、普罗米修斯(规划者)、奥拉克尔(架构/调试)、图书管理员(文档/代码搜索)、探索者(快速代码库 grep)、多模态观察者

- 后台代理:像真正的开发团队一样并行运行多个代理

- LSP & AST 工具:重构、重命名、诊断、AST 感知的代码搜索

- 哈希锚定编辑工具:

LINE#ID引用会在应用每次更改之前验证内容。实现精准编辑,零过时行错误 - 上下文注入:自动注入 AGENTS.md、README.md 和条件规则

- Claude Code 兼容性:完整钩子系统、命令、技能、代理和 MCP

- 内置 MCP:网络搜索(Exa)、context7(文档)、grep_app(GitHub 搜索)

- 会话工具:列出、阅读、搜索和分析会话历史

- 生产力功能:拉尔夫循环、待办事项强制执行、注释检查器、思考模式等

- Doctor 命令:内置诊断程序(

bunx oh-my-opencode doctor)可验证插件注册、配置、模型和环境 - 模型回退:

fallback_models可以在同一数组中混合普通模型字符串和每个回退的设置对象 - 文件提示:通过代理配置中的

file://支持从文件加载提示 - 会话恢复:自动从会话错误、上下文窗口限制和 API 失败中恢复

- 模型设置:代理与模型的匹配已内置于安装指南中

配置

有观点的默认设置,如果你坚持的话也可以调整。

请参阅配置文档。

快速概览:

- 配置位置:兼容层同时识别

oh-my-openagent.json[c]和旧版oh-my-opencode.json[c]插件配置文件。现有安装通常仍使用旧版文件名。 - JSONC 支持:支持注释和尾随逗号

- 代理:可为任何代理覆盖模型、温度、提示和权限

- 内置技能:

playwright(浏览器自动化)、git-master(原子提交) - 西西弗斯代理:主协调器,配备普罗米修斯(规划者)和墨提斯(计划顾问)

- 后台任务:可按提供商/模型配置并发限制

- 类别:领域特定的任务委派(视觉、业务逻辑、自定义)

- 钩子:25+ 个内置钩子,均可通过

disabled_hooks进行配置 - MCP:内置网络搜索(Exa)、context7(文档)、grep_app(GitHub 搜索)

- LSP:全面支持 LSP,并提供重构工具

- 实验性功能:激进截断、自动恢复等

作者注

想了解哲学理念吗? 请阅读超工作宣言。

我在个人项目上烧掉了 2.4 万美元的 LLM token。试遍了所有工具,把所有东西都调到了极限。最终胜出的是 OpenCode。

我遇到的每一个问题,解决方案都已内置于这个插件中。安装后即可使用。

如果 OpenCode 是 Debian/Arch,那么 OmO 就是 Ubuntu/Omarchy。

深受 AmpCode 和 Claude Code 的影响。许多功能被移植过来,且往往有所改进。我们仍在持续构建中。这就是 OpenCode。

其他框架承诺多模型编排,而我们直接交付。稳定性同样出色,而且功能真正实用。

我是这个项目的最狂热用户:

- 哪个模型的逻辑最敏锐?

- 谁是调试之神?

- 谁写得最好?

- 谁在前端领域占主导地位?

- 谁是后端专家?

- 日常使用哪个模型最快?

- 竞争对手都在推出什么?

这个插件就是精华的提炼。取其精华。如果有改进意见,欢迎提交 PR。

别再为选择框架而纠结了。 我会研究、借鉴最佳方案,并将其整合到这里。

听起来很自负?有更好的办法吗?那就贡献出来吧。我们非常欢迎。

与文中提到的任何项目或模型均无关联,纯属个人实验。

该项目的 99% 都是用 OpenCode 构建的。我其实不太懂 TypeScript。但这份文档是我亲自审阅并大幅改写的。

受到以下专业人士的喜爱:

- Indent

- 开发 Spray - 影响力营销解决方案、vovushop - 跨境电商平台、vreview - AI 商业评论营销解决方案

- Microsoft

- ELESTYLE

- 开发 elepay - 多移动支付网关、OneQR - 用于无现金解决方案的移动应用 SaaS

特别感谢 @junhoyeo 提供的这张精彩海报图片。

版本历史

v3.15.22026/04/05v3.15.12026/04/05v3.14.02026/03/26v3.13.12026/03/25v3.13.02026/03/25v3.12.32026/03/18v3.12.22026/03/18v3.12.12026/03/18v3.12.02026/03/17v3.11.22026/03/08v3.11.12026/03/07v3.11.02026/03/07v3.10.02026/03/02v3.9.02026/02/26v3.8.52026/02/24v3.8.42026/02/23v3.8.32026/02/22v3.8.22026/02/22v3.8.12026/02/22v3.8.02026/02/21常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。